Google Cloud et la robotique autonome : comment Google redéfinit l’usine 5.0

Dans la course mondiale vers l’usine 5.0, dominée par la convergence entre robotique autonome, intelligence artificielle et cloud distribué, Google impose progressivement une vision radicale : celle d’une industrie où la perception robotique, l’IA multimodale, la simulation physique et l’orchestration cloud deviennent les nouveaux moteurs de compétitivité

Alors que Microsoft mise sur l’intégration IA + Edge via Azure et que NVIDIA pousse l’ère du “Full Digital Twin” avec Omniverse et Jetson, Google avance avec une stratégie moins médiatisée mais redoutablement structurante : unifier l’infrastructure industrielle autour de son cloud, de ses modèles d’IA multimodale, et de sa filiale robotique Intrinsic, pour créer une robotique plus adaptable, plus autonome et surtout massivement scalable

Ce dossier analyse en profondeur comment Google redéfinit les fondations technologiques de l’usine 5.0.

1. Une vision complète : IA + perception + cloud + simulation

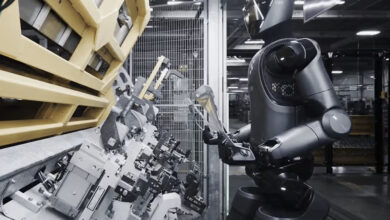

Si la robotique traditionnelle repose sur la programmation explicite, la robotique autonome exige des robots capables de comprendre leur environnement, d’apprendre en continu et d’optimiser leurs actions en temps réel.

C’est précisément dans cette zone grise entre perception avancée, IA générative et automatisation cognitive que Google construit son avantage.

L’approche du géant américain repose sur trois piliers :

1.1. L’infrastructure cloud : Google Cloud Vertex AI & Edge TPU

Google Cloud s’impose comme une plateforme robotique en elle-même. Grâce à :

- Vertex AI pour entraîner, déployer et gérer des modèles in situ et en edge

- Les Edge TPU permettant l’exécution locale d’IA haute performance sur les robots

- Anthos pour orchestrer les workloads industriels entre cloud, on-premise et edge

- Les API multimodales Gemini capables de traiter vision, langage, actions et séquences robotisées

Google transforme chaque robot en “cloud-native device”.

La robotique n’est plus un système clos : elle devient une infrastructure distribuée.

1.2. La perception avancée : vision 3D, multimodalité et apprentissage auto-supervisé

La puissance historique de Google dans la vision par ordinateur influence profondément la robotique :

- Segmentation 3D à large échelle (héritée de Google Maps & StreetView)

- Modèles de perception multimodale (Gemini vision-action)

- Motor skills préentraînés sur des millions de séquences robotiques

- Reconstruction d’environnements industriels complexes via NeRF et 3D Gaussian Splatting

Dans l’usine 5.0, où robots et humains collaborent, cette perception devient critique : elle permet de détecter les anomalies, anticiper les collisions, optimiser les trajectoires et adapter en temps réel les processus.

1.3. La simulation à grande échelle

Google bénéficie d’un avantage majeur rarement mis en avant : ses moteurs de simulation issus de DeepMind et de la recherche interne.

Intrinsic, par exemple, utilise des simulateurs physiques avancés pour :

- Générer des milliers de scénarios de manipulation

- Optimiser des trajectoires

- Automatiser la calibration

- Créer des jumeaux numériques industriels ultra-précis

Ces capacités, autrefois réservées aux laboratoires, sont désormais accessibles via Google Cloud.

2. Intrinsic : la pierre angulaire de l’industrialisation robotique

Fondée en 2021 au sein d’Alphabet, Intrinsic est la traduction concrète de l’ambition robotique de Google. Sa mission : abstraire la complexité de la robotique industrielle pour la rendre programmable comme du software.

2.1. Des robots reprogrammables sans code

Intrinsic développe une plateforme où l’on programme un robot non plus avec du code bas niveau, mais grâce à :

- Des interfaces no-code

- Des démonstrations vidéo (video-to-action)

- Des instructions en langage naturel (Gemini for Robotics)

- Des skills préentraînés (pick, place, assemble, manipulate)

Un ingénieur peut désormais montrer une tâche à un robot, et laisser l’IA en extraire automatiquement :

- les trajectoires

- les contraintes dynamiques

- les contacts

- et les séquences d’assemblage

Cela abaisse radicalement la barrière d’entrée de l’automatisation.

2.2. Une compatibilité large avec les robots industriels

Intrinsic ne fabrique pas de robots, mais s’intègre dans l’écosystème existant :

- KUKA

- Fanuc

- ABB

- Universal Robots

- Yaskawa

L’objectif : créer une couche logicielle universelle pour l’ensemble du marché robotique.

2.3. Le partenariat stratégique avec Siemens

En 2023, Siemens et Intrinsic ont annoncé une collaboration majeure : intégrer la plateforme Intrinsic dans le PLM et l’automatisation Siemens Xcelerator.

Cela ouvre la voie à :

- la programmation par IA dans les automatismes industriels

- la robotique collaborative dans l’industrie lourde

- des pipelines digital twin + AI + robotique connectés à Google Cloud

C’est l’une des alliances les plus structurantes du futur marché.

3. Google et l’usine 5.0 : une nouvelle architecture industrielle

L’usine 5.0 n’est pas seulement automatisée : elle est intelligente, adaptative et collaborative.

Google pousse un modèle où :

3.1. Chaque machine devient un nœud intelligent

Grâce au cloud et au edge, les robots échangent en temps réel :

- données de perception

- prédictions d’IA

- feedbacks sensorimoteurs

- planning de trajectoire

Une chaîne de montage devient un “système multi-agents” orchestré en continu par Google Cloud.

3.2. Les robots apprennent les uns des autres

Avec les modèles partagés sur Vertex AI :

- Un robot apprenant une tâche dans une usine peut transmettre ses “skills” à tous les autres robots du réseau

- Google crée ainsi la première mémoire collective robotique distribuée

C’est le même principe que la flotte de Tesla, appliqué à la robotique industrielle.

3.3. Humans + Robots : la collaboration augmentée

L’usine 5.0 met l’humain au centre.

Google propose :

- Gemini comme interface universelle humain-robot (langage naturel + vision)

- ARCore pour guider les opérateurs via réalité augmentée

- des robots capables de comprendre le contexte humain (gestes, intention, sécurité)

La symbiose humain-robot devient une réalité opérationnelle.

4. L’impact sur la supply chain mondiale

L’intégration de l’IA Google dans la robotique transforme profondément la supply chain :

4.1. Automatisation flexible

Les lignes deviennent reconfigurables en quelques minutes plutôt qu’en semaines.

4.2. Maintenance prédictive + optimisation énergétique

Les modèles de Google, entraînés sur des données massives, permettent :

- de prévoir les pannes

- d’optimiser la consommation électrique

- de réduire les temps morts

4.3. Mass Customization = production à la demande

L’usine 5.0 basée sur IA + perception permet :

- des micro-séries

- de l’assemblage dynamique

- une production orientée client final

Les robots deviennent capables de changer de tâche plusieurs fois par jour.

5. Les défis et limites de la stratégie Google

Même si l’approche Google est très ambitieuse, plusieurs obstacles subsistent.

5.1. L’intégration industrielle

L’industrie lourde est conservatrice.

L’introduction d’IA dans des environnements critiques demande :

- validation réglementaire

- robustesse temps réel

- cybersécurité avancée

5.2. Le manque d’adoption standardisée

La robotique reste fragmentée par des standards propriétaires.

Google pousse vers plus d’universalité, mais ce changement prend du temps.

5.3. La souveraineté industrielle

Les clients européens et asiatiques peuvent être réticents à confier leurs données de production à un cloud américain.

Google multiplie les accords pour répondre à cette inquiétude, mais le sujet reste sensible.

6. Google impose une nouvelle grammaire de l’automatisation

Avec Google Cloud, Gemini, Intrinsic et son expertise en perception, Google redéfinit profondément la robotique industrielle.

L’entreprise ne rivalise pas seulement avec les acteurs traditionnels de la robotique :

elle restructure l’industrie autour d’une nouvelle infrastructure cognitive.

Dans l’usine 5.0 :

- La perception devient une API

- Les robots apprennent comme des modèles IA

- La programmation disparaît au profit de la démonstration

- Le cloud devient l’épine dorsale de l’automatisation

- Les robots coopèrent en réseau

Google ne construit pas des robots Google construit la plateforme mondiale qui permettra à tous les robots de devenir réellement autonomes.

C’est peut-être la stratégie industrielle la plus ambitieuse de la décennie.

FAQ – Google Cloud, IA et la robotique autonome dans l’usine 5.0

2. Quel rôle joue la filiale robotique Intrinsic dans la stratégie de Google ?

Intrinsic constitue la pièce maîtresse de la stratégie robotique de Google. Elle vise à simplifier radicalement l’automatisation en remplaçant la programmation traditionnelle par des interfaces no-code, la démonstration vidéo et les instructions en langage naturel. Intrinsic offre également une compatibilité large avec les robots industriels existants, ce qui lui permet de devenir une couche logicielle universelle pour l’automatisation intelligente.

3. En quoi la perception robotique avancée est-elle un avantage compétitif pour Google ?

La perception est l’un des domaines où Google dispose d’un leadership historique grâce à sa maîtrise de la vision 3D, des modèles multimodaux et de l’apprentissage auto-supervisé. Cette expertise permet aux robots équipés par Google de détecter les anomalies, anticiper les collisions, optimiser les trajectoires et comprendre les scènes industrielles avec un niveau de précision inégalé. Cette perception est le socle de la robotique autonome de nouvelle génération.

4. Comment Google Cloud contribue-t-il à rendre les robots plus autonomes ?

Google Cloud fournit l’infrastructure nécessaire pour entraîner, déployer et orchestrer l’IA à grande échelle. Vertex AI centralise l’apprentissage et la gestion des modèles, tandis que les Edge TPU permettent leur exécution locale sur les robots avec des performances temps réel. Anthos assure la coordination entre cloud, edge et on-premise. Cette combinaison transforme la robotique en un système distribué où chaque machine peut apprendre et partager ses compétences avec le reste du réseau.

5. Quels impacts la stratégie de Google a-t-elle sur la supply chain mondiale ?

La robotique autonome alimentée par Google rend les chaînes de production plus flexibles, plus rapides à reconfigurer et capables de produire des micro-séries sur demande. L’IA permet également d’améliorer la maintenance prédictive, de réduire les coûts énergétiques et de limiter les interruptions. L’ensemble favorise une production plus personnalisée, plus résiliente et plus efficiente, ouvrant la voie à une supply chain réellement pilotée par la donnée et l’intelligence distribuée.

6. Quels sont les principaux obstacles auxquels Google doit encore faire face ?

Plusieurs défis demeurent, notamment la résistance des industries traditionnelles à adopter des infrastructures cloud-IA critiques, l’absence de standards universels en robotique et les préoccupations géopolitiques liées à la souveraineté des données. Google travaille à atténuer ces limites avec des partenariats stratégiques, comme celui conclu avec Siemens, et avec des solutions hybrides permettant de conserver certaines données en local, mais l’adoption massive demandera encore du temps.